PCA VS ICA (Իմացեք տարբերությունը) – Բոլոր տարբերությունները

Բովանդակություն

Մաթեմատիկան գեղեցիկ և հուզիչ գիտություն է, բայց դրա գեղեցկությունը հասկանալու համար պետք է քայլ առ քայլ գնալ: Դուք չեք կարող միանգամից մինչև վերջ գնալ: Այս քայլ առ քայլ անցումը հեշտացնելու համար կարող եք օգտագործել մի քանի բանաձևեր և մեթոդներ:

Տես նաեւ: Ո՞րն է տարբերությունը Pathfinder-ի և D&D-ի միջև: (Պատասխանել է) – Բոլոր տարբերություններըPCA-ն և ICA-ն երկու այդպիսի մեթոդներ են, որոնք օգտագործվում են տվյալների հավաքածուն որոշակի հիմունքներով բաժանելու համար: Երկու տեխնիկան էլ միացնում է աղբյուրները գծային եղանակով՝ նորերը ստանալու համար: Նրանք երկուսն էլ բավականին նման են, բայց շատ տարբեր են միմյանցից:

Երկու տեխնիկայի միջև ամենապրակտիկ տարբերությունն այն է, որ PCA-ն օգտակար է ձեր տվյալների կրճատված աստիճանի ներկայացումը գտնելու համար: Մյուս կողմից, ICA-ն նախատեսված է ձեր տվյալների անկախ ենթատարրերը գտնելու համար:

Առհասարակ, PCA-ն սեղմում է տվյալները, իսկ ICA-ն առանձնացնում է դրանք:

Եթե ցանկանում եք ավելին իմանալ այս տեխնիկայի մասին, կարդացեք մինչև վերջ:

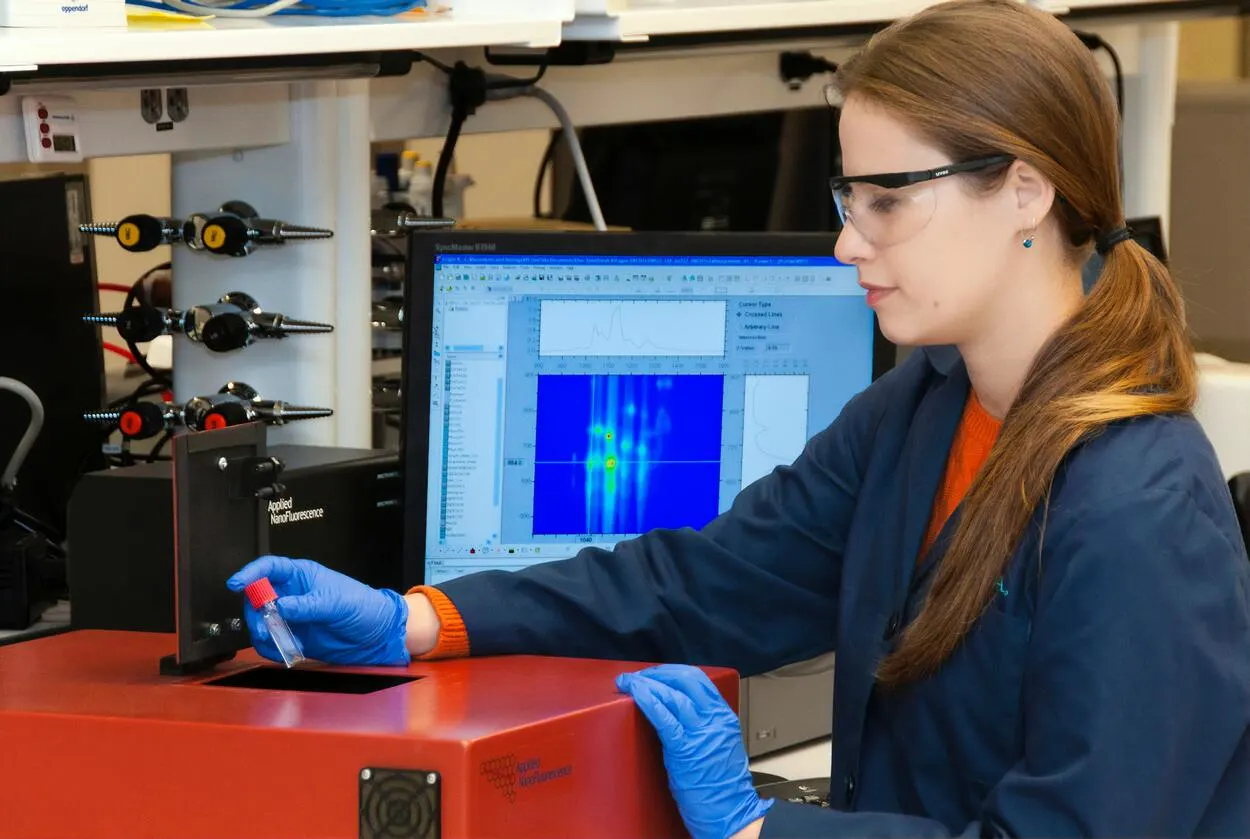

PCA և ICA տեխնիկան օգտագործվում են տարբեր փորձարկման գործընթացներում:

Ի՞նչ է PCA:

PCA-ն կամ հիմնական բաղադրիչի վերլուծությունը կրճատման մեթոդ է, որն օգտագործվում է մեծ տվյալների հավաքածուների չափերը նվազեցնելու համար՝ դրանք փոխելով փոքրերի և պահպանելով բոլոր անհրաժեշտ տեղեկությունները անփոփոխ:

Երբ դուք կրճատում եք տվյալների հավաքածուի չափը, դուք զոհաբերում եք ճշգրտությունը, սակայն չափերի կրճատումը կապված է ճշգրտության զոհաբերման հետ՝ հանուն պարզության:

Դուք կարող եք ավելի հեշտ ուսումնասիրել և պատկերացնել տվյալների փոքր հավաքածուները, իսկ մեքենայական ուսուցման ալգորիթմները կարող են վերլուծել տվյալները ավելի մատչելի և արագ, քանի որկան ավելի քիչ փոփոխականներ:

Տես նաեւ: Bō VS Quarterstaff. Ո՞րն է ավելի լավ զենք: - Բոլոր տարբերություններըԱմփոփելու համար, PCA-ն նպատակ ունի նվազեցնել փոփոխականների թիվը տվյալների հավաքածուում` միաժամանակ հնարավորինս շատ տեղեկատվություն պահպանելով:

Ի՞նչ է ICA-ն:

Անկախ բաղադրիչների վերլուծությունը (ICA) վիճակագրական տեխնիկա է, որը բացահայտում է պատահական փոփոխականների, չափումների և ազդանշանների թաքնված գործոնները:

Անկախ բաղադրիչների վերլուծությունը (ICA) վերցնում է խառը ազդանշան և այն բաժանում անկախ աղբյուրների: Դուք կարող եք նաև դա անվանել կոկտեյլ երեկույթի խնդիր կամ կույր աղբյուրից բաժանման խնդիր:

Երբ կոկտեյլ խնջույքի եք լինում, բոլորը խոսում են տարբեր բաների մասին, բայց ձեր ուղեղն ու ականջները դեռ կարողանում են գտնել և նույնականացնել մեկ ձայն, որը ցանկանում եք լսել:

Նմանապես, ICA-ն աշխատում է յուրաքանչյուր ազդանշան ազդանշանների խառնուրդից անջատելու համար անկախ հաղորդագրության մեջ:

Տարբերությունը ICA-ի և PCA-ի միջև

Ահա PCA-ի և PCA-ի միջև եղած տարբերությունների ցանկը: ICA-ն ձեզ համար:

- ICA-ն լավ է ձեր տվյալների անկախ ենթատարրերը գտնելու համար, մինչդեռ PCA-ն ձեզ ստանում է ցածր աստիճանի ներկայացում:

- PCA-ն սեղմում է տվյալները, մինչդեռ ICA-ն առանձնացնում է դրանք:

- PCA-ում բաղադրիչները ուղղանկյուն են. ICA-ում, նրանք կարող են չլինել: ICA-ում դուք փնտրում եք ինքնուրույն տեղադրված բաղադրիչներ:

- Մինչ PCA-ն առավելագույնի է հասցնում մուտքային ազդանշանի և հիմնական բաղադրիչների տարբերությունը, ICA-ն նվազագույնի է հասցնում հայտնաբերված բաղադրիչների միջև փոխադարձ տեղեկատվությունը:

- PCAդասակարգում է հատկանիշները ամենակարևորից մինչև ամենանվազ նշանակալի: Այնուամենայնիվ, ICA-ում բաղադրիչներն ըստ էության դասավորված և հավասար են:

- PCA-ն նվազեցնում է չափերը՝ կանխելու չափից ավելի հարմարեցումը, մինչդեռ ICA-ն վերցնում է խառը ազդանշանը և վերածում այն իր անկախ աղբյուրների ազդանշանների: 3>

- PCA-ն կենտրոնացած է շեղումները առավելագույնի հասցնելու վրա, մինչդեռ ICA-ն կենտրոնացած չէ շեղումների վրա :

Ահա մի համապարփակ տեսանյութ PCA-ի և ICA-ի մասին:

PCA VS ICA

Ե՞րբ կարող եք օգտագործել ICA-ն:

ICA-ն բազմաթիվ փոփոխականներից կազմված տվյալների ընդարձակ փաթեթը կրճատելու միջոց է ավելի փոքր թվով ինքնակազմակերպվող բաղադրիչների:

Տվյալների հավաքածուն բաղկացած է բազմաթիվ փոփոխականներից, ուստի Անկախ Բաղադրիչների վերլուծությունը (ICA) օգտագործվում է դրանք ավելի փոքր չափերի կրճատելու համար, որպեսզի ընկալվեն որպես ինքնակազմակերպված ֆունկցիոնալ ցանցեր: Դուք կարող եք օգտագործել ICA ոչ ֆիզիկական ազդանշանները վերլուծելու համար:

Դրա կիրառություններից մի քանիսը ներառում են.

- Կանխատեսել ֆոնդային շուկայի գները

- Նեյրոնների օպտիկական պատկերում

- Դեմքի ճանաչում

- Աստղագիտություն և տիեզերագիտություն

- Բջջային հեռախոսային հաղորդակցություն

Ե՞րբ կարող եք օգտագործել PCA-ն:

PCA-ն չափերի կրճատման տեխնիկա է, որն օգտագործվում է պատկերի սեղմման, դեմքի ճանաչման և համակարգչային տեսողության տիրույթներում:

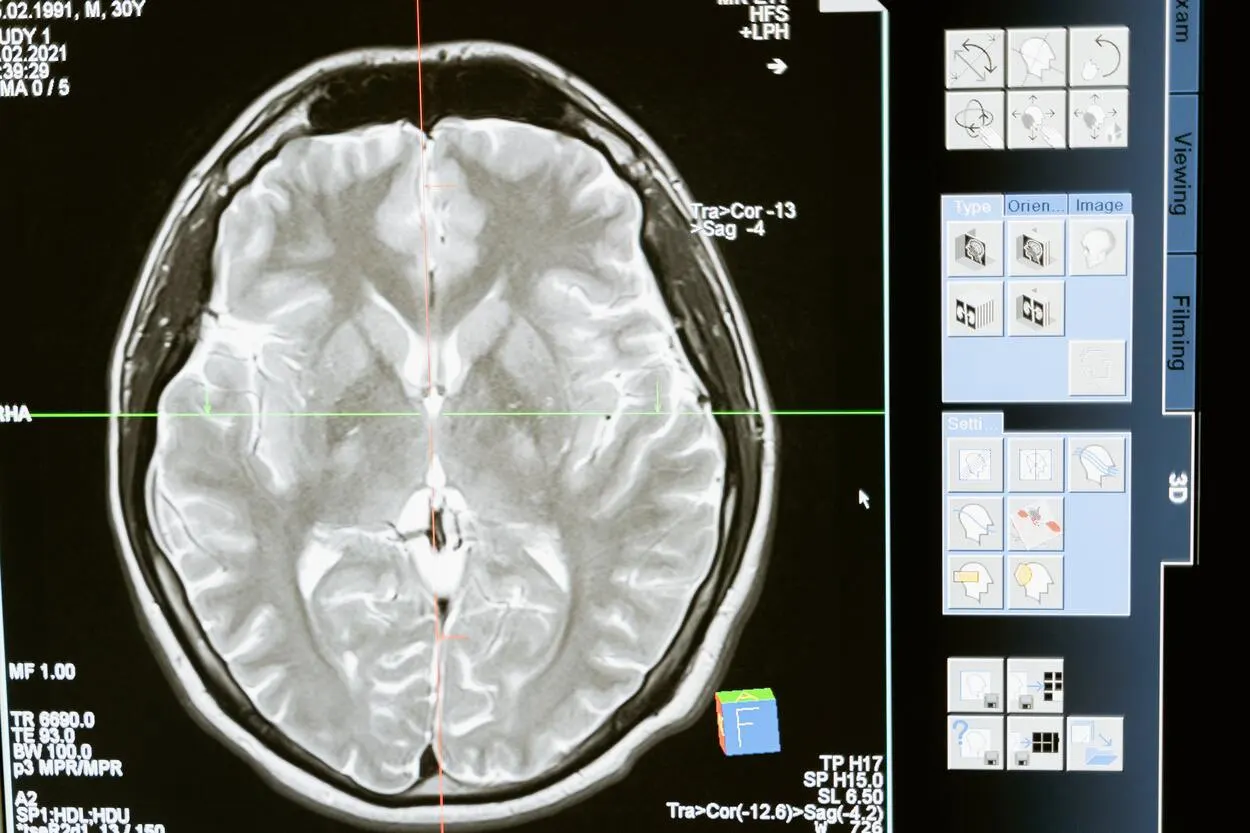

Այն ամենակարևոր ալգորիթմներից մեկն է, որն օգտագործվում է ցանկացած չափսերի կրճատման համար։ տվյալները՝ առանց կորցնելու իրենց էական նրբությունները: Դուք կարող եք այն օգտագործել տարբեր ոլորտներում՝ սկսած նյարդաբանությունից մինչևքանակական ֆինանսներ.

Դրա կիրառություններից մի քանիսը ներառում են՝

- Դեմքի ճանաչում

- Պատկերի սեղմում

- Սպայկի կողմից առաջացած կովարիանսային վերլուծություն (Նյարդագիտություն)

- Կենսաինֆորմատիկա

- Տվյալների արդյունահանում

Նեյրո վերլուծություն PCA և ICA տեխնիկայի միջոցով:

Արդյո՞ք ICA բաղադրիչները ուղղանկյուն են:

ICA բաղադրիչները ոչ ուղղանկյուն են. փոխակերպումներ, որոնց լուծումն ունի ավելի բարձր կարգի վիճակագրություն:

Արդյո՞ք PCA բաղադրիչներն անկախ են:

PCA-ի բոլոր բաղադրիչները վիճակագրորեն անկախ են:

PCA բաղադրիչները չունեն համընկնող տեղեկություններ դրանց միջև: Դրա բաղադրիչները փոխադարձաբար ուղղանկյուն են և ներառում են երկրորդ կարգի վիճակագրություն:

PCA-ն գծային է, թե ոչ գծային:

PCA-ն ուղղանկյուն գծային փոխակերպում է:

Այն տվյալները փոխակերպում է նոր կոորդինատային համակարգի այնպես, որ ամենակարևոր տարբերությունը ընկած է առաջին կոորդինատի վրա, երկրորդ ամենամեծ շեղումը: երկրորդ կոորդինատի վրա և այլն:

Ի՞նչ է ոչ գծային ICA-ն:

Ոչ գծային ICA-ն կենտրոնանում է տվյալների գեներացնող թաքնված փոփոխականները վերականգնելու ունակության վրա, որը չվերահսկվող ներկայացման ուսուցման հիմնական ասպեկտն է:

Տվյալներն ավելացվում են օժանդակ փոփոխականներով: , ինչպես ժամանակային ինդեքսը, ժամանակային շարքի պատմությունը կամ հասանելի ցանկացած այլ բան:

Դուք կարող եք սովորել ոչ գծային ICA՝ տարբերակելով ճշգրիտ ընդլայնված տվյալները և տվյալներըպատահական օժանդակ փոփոխական: Լոգիստիկ ռեգրեսիայի միջոցով շրջանակը կարող է իրականացվել ալգորիթմորեն:

Ինչու է ICA-ն ոչ-գաուսյան:

ICA-ի հիմնական տարրն այն է, որ թաքնված գործոնները ենթադրվում են որպես ոչ Գաուսական:

ICA-ն չի առանձնացնի երկու Գաուսի գործոն, քանի որ այն հիմնված է նորմալությունից շեղման վրա: . Հաշվի առնելով երկու Գաուսի փոփոխականները, շրջանաձև հոդերի հավանականության մեկ լուծում չկա:

Ո՞րն է ավելի լավ; ICA, թե՞ PCA:

Երկուսն էլ ավելի լավն են իրենց տեսանկյունով և կիրառմամբ:

PCA-ն կարևոր է ձեր տվյալների ցածր աստիճանի ներկայացումը գտնելու համար, իսկ ICA-ն անկախ ենթակետ գտնելու համար: - Ձեր տվյալների տարրերը: Սովորական լեզվով ասած՝ PCA-ն սեղմում է տվյալները, իսկ ICA-ն առանձնացնում է դրանք: Այսպիսով, երկուսն էլ օգտակար են:

Վերջնական մտքեր

ICA-ն և PCA-ն տեխնիկա են, որոնք օգտագործվում են python-ի խնդիրների լուծման համար. երկուսն էլ աշխատում են նույն սկզբունքներով, բայց կատարում են տարբեր գործառույթներ:

ICA-ն օգնում է գտնել ձեր տվյալների անկախ ենթատարրերը և առանձնացնել դրանք: Ավելին, ICA-ն նվազագույնի է հասցնում հայտնաբերված բաղադրիչների միջև փոխադարձ տեղեկատվությունը և տալիս է ձեզ ինքնուրույն տեղադրված բաղադրիչներ:

Սակայն, PCA-ն սեղմում է տվյալները և ստանում է ուղղանկյուն բաղադրիչներով իջեցված աստիճանի ներկայացում, ինչը առավելագույնի է հասցնում մուտքային ազդանշանի տարբերությունը: հիմնական բաղադրիչների հետ միասին:

Առնչվող հոդվածներ

Այս հոդվածի վեբ պատմության տարբերակը կարող եք գտնել այստեղ: