PCA VS ICA (kend forskellen) - Alle forskellene

Indholdsfortegnelse

Matematik er en smuk og spændende videnskab, men du er nødt til at gå trin for trin for at forstå dens skønhed. Du kan ikke gå hele vejen på én gang. For at lette denne trinvise overgang kan du bruge flere formler og metoder.

PCA og ICA er to sådanne metoder, der anvendes til at opdele et datasæt på et bestemt grundlag. Begge teknikker kombinerer kilder på en lineær måde for at få nye kilder. De ligner hinanden meget, men er alligevel meget forskellige fra hinanden.

Den mest praktiske forskel mellem de to teknikker er, at PCA er nyttig til at finde en repræsentation af data med reduceret rang, mens ICA derimod er beregnet til at finde uafhængige delelementer af dataene.

I lægmandssprog komprimerer PCA data, og ICA adskiller dem.

Hvis du vil vide mere om disse teknikker, skal du læse til slutningen.

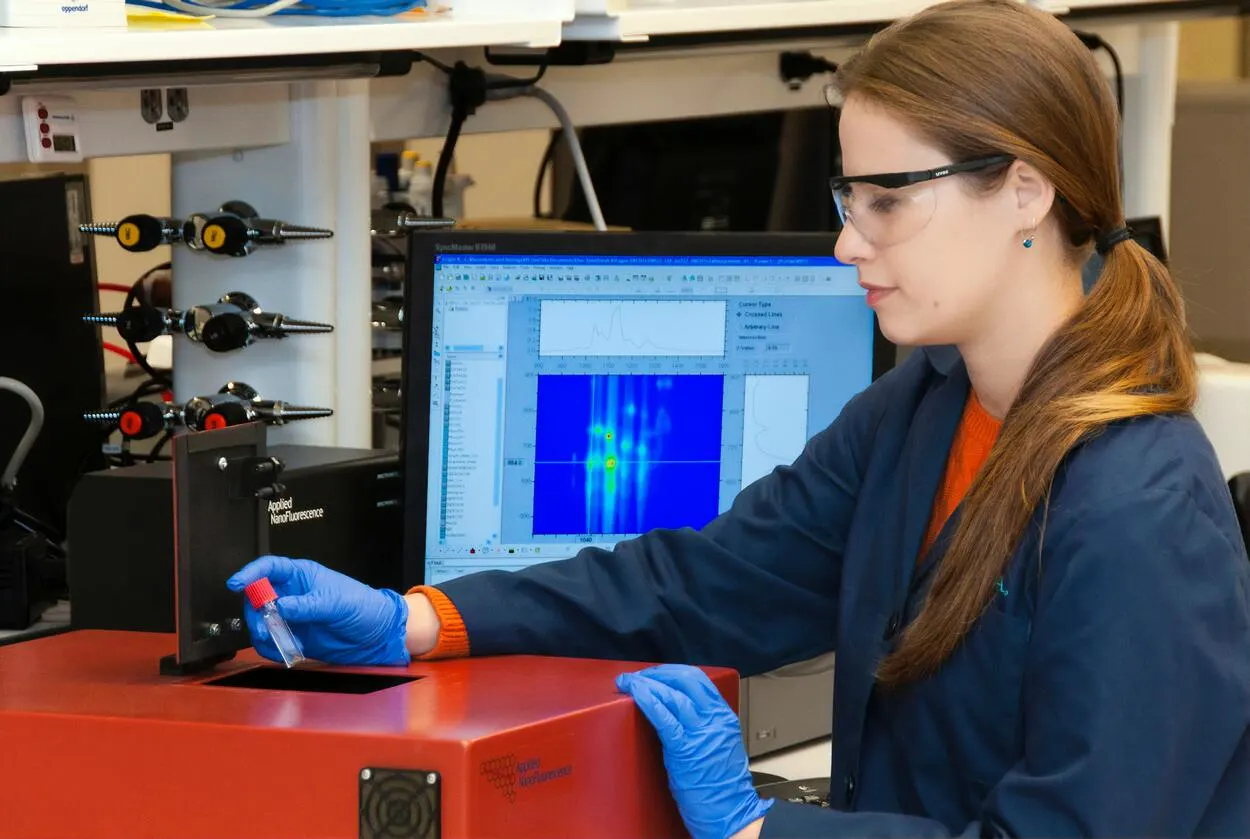

PCA- og ICA-teknikker anvendes i forskellige testprocesser.

Hvad er PCA?

PCA eller Principal Component Analysis er en reduktionsmetode, der bruges til at reducere dimensionerne i store datasæt ved at ændre dem til mindre dimensioner og bevare alle de nødvendige oplysninger intakte.

Når du reducerer størrelsen af et datasæt, går du på kompromis med nøjagtigheden, men dimensionalitetsreduktion handler om at ofre nøjagtigheden for enkelhed.

Du kan nemmere udforske og visualisere mindre datasæt, og maskinlæringsalgoritmer kan analysere data mere tilgængeligt og hurtigere, fordi der er færre variabler.

Kort sagt har PCA til formål at reducere antallet af variabler i et datasæt og samtidig bevare så meget information som muligt.

Hvad er ICA?

ICA (Independent Component Analysis) er en statistisk teknik, der afdækker skjulte faktorer bag sæt af tilfældige variabler, målinger og signaler.

ICA (Independent Component Analysis) tager et blandet signal og adskiller det i uafhængige kilder. Man kan også kalde det et cocktailpartyproblem eller et problem med blind kildeadskillelse.

Når du er til et cocktailparty, taler alle om forskellige ting, men din hjerne og dine ører kan stadig finde og identificere en enkelt stemme, som du gerne vil høre.

På samme måde arbejder ICA med at adskille hvert signal fra en blanding af signaler til et uafhængigt budskab.

Forskellen mellem ICA og PCA

Her er en liste over forskellene mellem PCA og ICA til dig.

- ICA er god til at finde uafhængige delelementer af dine data, mens PCA giver dig en repræsentation med reduceret rang.

- PCA komprimerer data, mens ICA adskiller dem.

- I PCA er komponenterne ortogonale; i ICA er de det måske ikke. I ICA leder du efter uafhængigt placerede komponenter.

- Mens PCA maksimerer variansen af indgangssignalet og hovedkomponenterne, minimerer ICA den gensidige information mellem de fundne komponenter.

- PCA rangerer funktionerne fra de mest betydningsfulde til de mindst betydningsfulde, men i ICA er komponenterne i det væsentlige uordnede og lige store.

- PCA reducerer dimensionerne for at forhindre overpasning, mens ICA tager det blandede signal og omdanner det til dets uafhængige kildesignaler.

- PCA er fokuseret på at maksimere varianserne, mens ICA ikke er koncentreret om varianserne .

Her er en omfattende video om PCA og ICA.

PCA VS ICA

Hvornår kan du bruge ICA?

ICA er en metode til at reducere et omfattende datasæt med mange variabler til et mindre antal selvorganiserede komponenter.

Et datasæt består af mange variabler, så ICA (Independent Components Analysis) bruges til at reducere dem til mindre dimensioner, så de kan forstås som selvorganiserede funktionelle netværk. Du kan bruge ICA til at analysere ikke-fysiske signaler.

Nogle få af dens anvendelser omfatter;

- Forudsigelse af aktiemarkedspriser

- Optisk billeddannelse af neuroner

- Ansigtsgenkendelse

- Astronomi og kosmologi

- Mobiltelefonkommunikation

Hvornår kan du bruge PCA?

PCA er en teknik til reduktion af dimensioner, der anvendes til billedkomprimering, ansigtsgenkendelse og computer vision-områder.

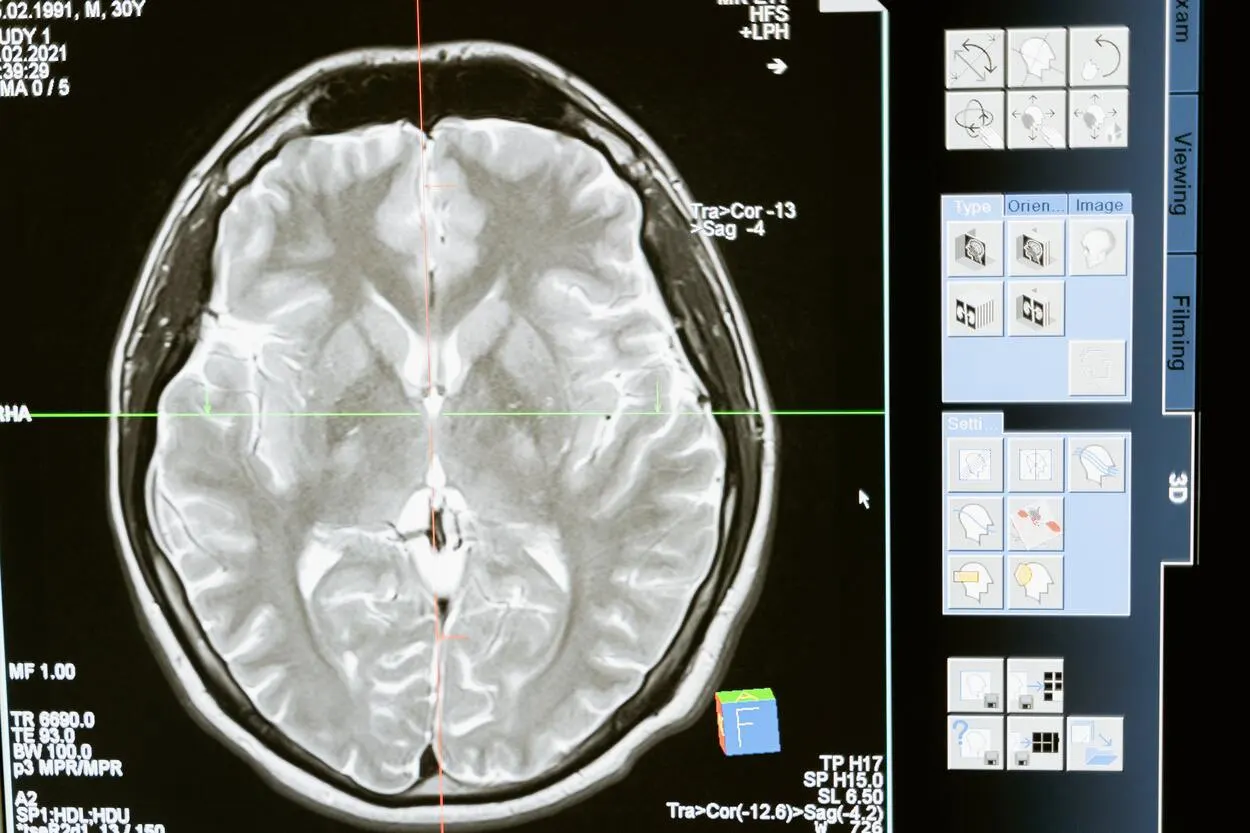

Det er en af de mest kritiske algoritmer, der anvendes til dimensionalitetsreduktion af data uden at miste de væsentlige dele af dem. Du kan bruge den på forskellige områder lige fra neurovidenskab til kvantitativ finansiering.

Nogle af dens anvendelsesområder omfatter;

- Ansigtsgenkendelse

- Komprimering af billeder

- Spike-udløst kovariansanalyse (Neurovidenskab)

- Bioinformatik

- Datamining

Neuroanalyse ved hjælp af PCA- og ICA-teknikker.

Er ICA-komponenter ortogonale?

ICA-komponenterne er ikke-ortogonale; dekorrelerende transformationer, hvis løsning har statistikker af højere orden.

Er PCA-komponenter uafhængige?

Alle komponenterne i PCA er statistisk uafhængige.

PCA-komponenterne har ingen overlappende information mellem sig. Komponenterne er indbyrdes ortogonale og omfatter statistik af anden orden.

Er PCA lineær eller ikke-lineær?

PCA er en ortogonal lineær transformation.

Den omdanner dataene til et nyt koordinatsystem, så den største varians ligger på den første koordinat, den næststørste varians på den anden koordinat osv.

Hvad er ikke-lineær ICA?

Ikke-lineær ICA fokuserer på evnen til at genfinde de latente variabler, der genererer dataene, hvilket er et grundlæggende aspekt af uovervåget indlæring af repræsentationer.

Dataene suppleres med hjælpevariabler, som f.eks. tidsindekset, tidsseriens historie eller hvad der ellers er tilgængeligt.

Du kan lære ikke-lineær ICA ved at skelne mellem præcise forstærkede data og data med en randomiseret hjælpevariabel. Gennem logistisk regression kan rammen implementeres algoritmisk.

Hvorfor er ICA ikke-Gaussian?

Et nøgleelement i ICA er, at latente faktorer antages at være ikke-Gaussianske.

ICA vil ikke adskille to gaussiske faktorer, da den er baseret på afvigelse fra normalitet. Med to gaussiske variabler er der ikke en enkelt løsning for en cirkulær fælles sandsynlighed.

Se også: Hvad er forskellen: Hærens læger og korpsfolk - Alle forskelleneHvilken er bedst: ICA eller PCA?

Begge er bedre i deres perspektiv og anvendelse.

PCA er vigtig for at finde en repræsentation af data med reduceret rang og ICA for at finde uafhængige delelementer af dataene. PCA komprimerer dataene, mens ICA adskiller dem. Begge dele er altså nyttige.

Se også: UberX VS UberXL (deres forskelle) - Alle forskelleneAfsluttende overvejelser

ICA og PCA er teknikker, der bruges til at løse python-problemer - begge arbejder efter samme principper, men udfører forskellige funktioner.

ICA hjælper med at finde uafhængige delelementer af dine data og adskiller dem. ICA minimerer desuden den gensidige information mellem de fundne komponenter og giver dig uafhængigt placerede komponenter.

PCA komprimerer imidlertid data og giver dig en repræsentation med reduceret rang med ortogonale komponenter, som maksimerer variansen af indgangssignalet sammen med hovedkomponenterne.

Relaterede artikler

Webhistorie-versionen af denne artikel kan findes her.