PCA VS ICA(違いを知ろう) - All The Differences

目次

数学は美しくエキサイティングな科学ですが、その美しさを理解するには一歩一歩進む必要があります。 一度にすべての道を進むことはできません。 この一歩一歩の移行を容易にするために、いくつかの公式や方法を使用することができます。

PCAとICAは、データセットを特定の基準で分割するために使用される2つの方法です。 どちらもソースを線形に組み合わせて新しいソースを得る方法です。 両者はよく似ていますが、互いに非常に異なっています。

両者の最も実用的な違いは、PCAがデータのランクを下げた表現を見つけるのに有効であるのに対し、ICAはデータの独立した下位要素を見つけるのに有効であることです。

平たく言えば、PCAはデータを圧縮し、ICAはデータを分離する。

関連項目: ウェービーヘアとカーリーヘアの違いとは?もっと詳しく知りたい方は、最後までお読みください。

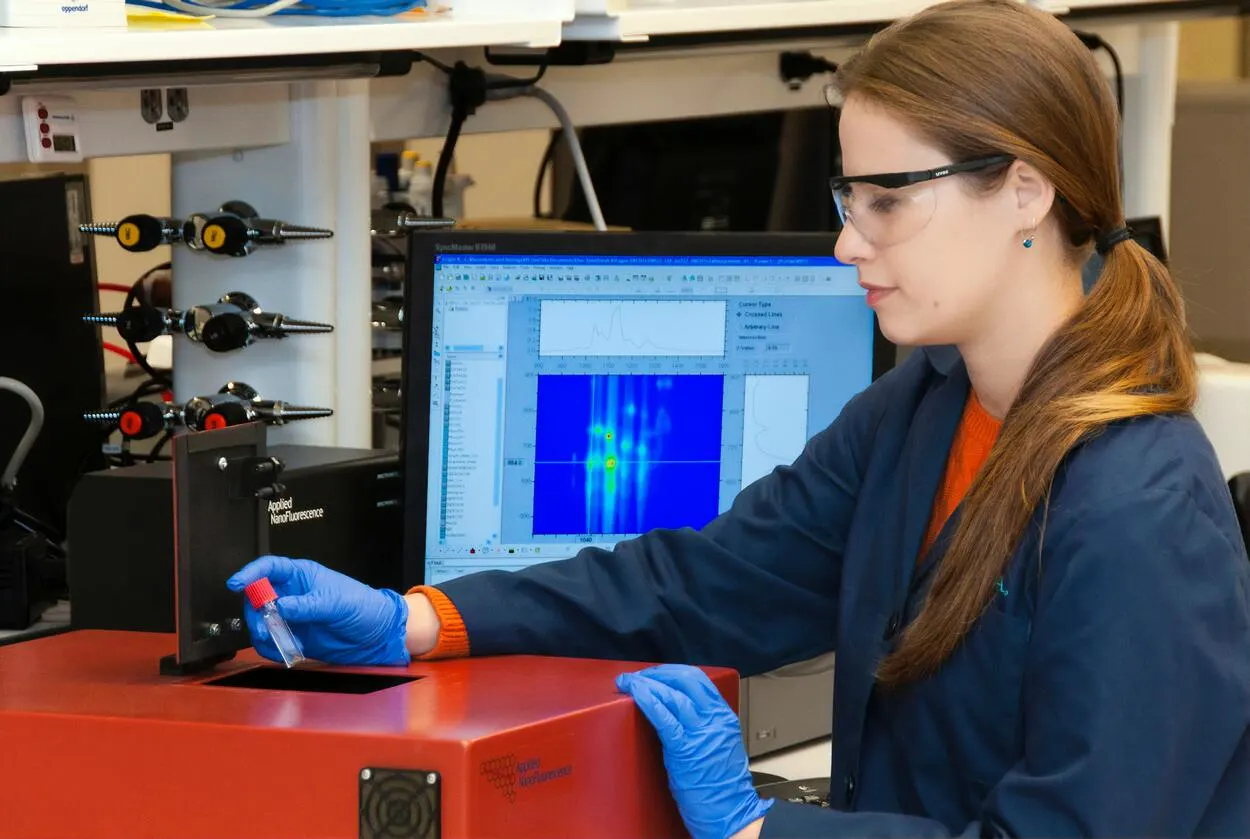

PCAやICAの技術は、様々なテスト工程で活用されています。

PCAとは?

PCA(主成分分析)は、大規模なデータセットの次元を小さくして、必要な情報をそのまま保持するために用いられる削減手法です。

データセットのサイズを小さくすると、精度が犠牲になりますが、次元削減は精度を犠牲にしてシンプルにすることが重要です。

より小さなデータセットの探索と可視化が容易になり、機械学習アルゴリズムは変数が少ないため、よりアクセスしやすく、より速くデータを分析することができます。

要約すると、PCAはデータセットの変数の数を減らし、できるだけ多くの情報を保存することを目的としています。

ICAとは?

独立成分分析(ICA)は、ランダムな変数、測定値、信号の集合の背後にある隠れた要因を発見する統計技術です。

独立成分分析(ICA)は、混合信号を独立したソースに分離します。 カクテルパーティー問題やブラインドソース分離問題とも呼ばれますね。

カクテルパーティーの席で、みんなが違うことを話していても、脳と耳は聞きたい一人の声を探し出し、識別することができるのです。

同様に、ICAは、混合された信号からすべての信号を独立したメッセージに分離する働きをします。

ICAとPCAの違い

ここでは、PCAとICAの違いをまとめてみましたので、参考にしてください。

- ICAはデータの独立した部分要素を見つけるのに適しており、PCAはランクを下げた表現を得ることができます。

- PCAがデータを圧縮するのに対し、ICAはデータを分離する。

- PCAでは成分は直交しているが、ICAでは直交していない場合がある。 ICAでは、独立に配置された成分を探すことになる。

- PCAが入力信号と主成分の分散を最大化するのに対し、ICAは見つかった成分間の相互情報を最小化します。

- PCAでは、特徴量の多いものから少ないものへとランク付けされますが、ICAでは、基本的に成分は順序付けされず、等しいものとなります。

- PCAはオーバーフィッティングを防ぐために次元を小さくし、ICAは混合信号をその独立したソースの信号に変換する。

- PCAは分散を最大化することに重点を置いているが、ICAは分散に重点を置いていない .

PCAとICAについての総合動画をご紹介します。

PCA VS ICA

ICAはいつから使えるの?

ICAとは、多数の変数からなる膨大なデータセットを、より少数の自己組織化された成分に還元する方法である。

データセットは多くの変数から構成されているため、独立成分分析(ICA)を用いて、より小さな次元に落とし込み、自己組織化された機能ネットワークとして理解することができます。 ICAを用いて非物理信号を分析することができます。

その応用例はほとんどありません;

- 株式市場の価格を予測する

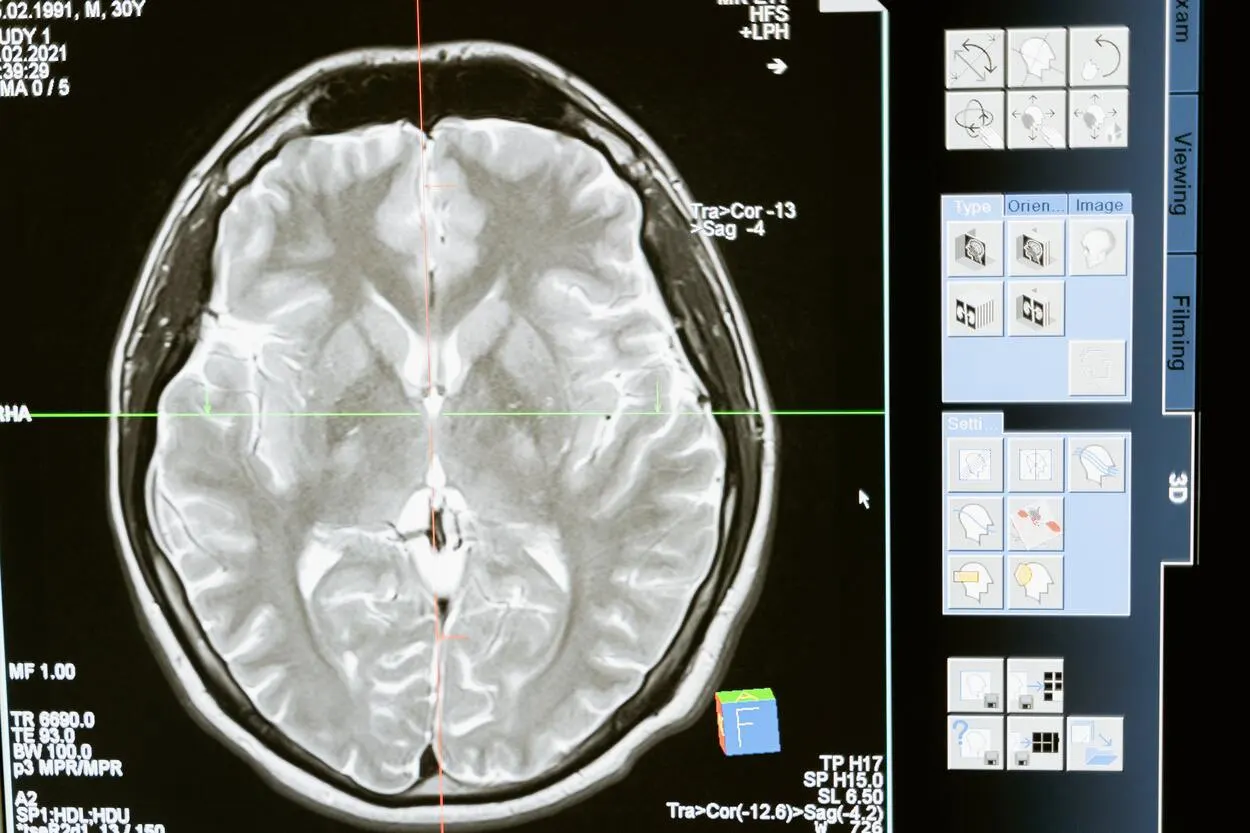

- 神経細胞の光イメージング

- 顔認識

- 天文・宇宙論

- 携帯電話通信

PCAはいつから使えるの?

PCAは、画像圧縮、顔認識、コンピュータビジョンの領域で使用される次元削減技術である。

神経科学から定量ファイナンスまで、さまざまな分野で利用されています。

その用途の一部をご紹介します;

- 顔認識

- 画像圧縮

- スパイクトリガー共分散解析 (神経科学)

- バイオインフォマティクス

- データマイニング

PCA、ICA技術によるニューロ解析。

ICA成分は直交しているか?

ICA成分は非直交であり、その解が高次の統計量を持つ装飾的な変換である。

PCA成分は独立か?

PCAの全成分は、統計的に独立しています。

関連項目: 流暢な言語話者とネイティブな言語話者の違いは何ですか?PCA成分は、成分間に重複する情報がなく、その成分は相互に直交し、2次統計に関与しています。

PCAはリニアかノンリニアか?

PCAとは直交線形変換のことです。

最も大きな分散が第1座標に、2番目に大きな分散が第2座標に、といった具合に、データを新しい座標系に変換するのです。

Non-Linear ICAとは?

Non-Linear ICAは、教師なし表現学習の基本である、データを生成する潜在的な変数を復元する能力に着目しています。

データは、タイムインデックスや時系列の履歴など、利用可能なものであれば何でも良いので、補助変数で補強されます。

正確な増強データとランダムな補助変数を持つデータを識別することで、非線形ICAを学習できます。 ロジスティック回帰を通じて、フレームワークをアルゴリズム的に実装することができます。

なぜICAは非ガウス的なのか?

ICAの重要な要素は、潜在的な因子が非ガウス的であると仮定していることです。

ICAは正規性からの逸脱に基づくので、2つのガウス因子を分離することはできない。 2つのガウス変数がある場合、円形の結合確率の解は1つではないのだ。

ICAとPCA、どちらが良いのでしょうか?

どちらも視点や使い方が優れています。

平たく言えば、PCAはデータを圧縮し、ICAはデータを分離する。 だから、どちらも有用なのだ。

最終的な感想

ICAとPCAはpythonの問題解決に使われる技術で、どちらも似た原理で動くが、機能は異なる。

ICAは、データから独立した部分要素を見つけ出し、それらを分離するのに役立ちます。 また、ICAは、見つけ出した成分間の相互情報を最小化し、独立して配置された成分を得ることができます。

しかし、PCAはデータを圧縮し、直交成分による減ランク表現を得ることができ、主成分とともに入力信号の分散を最大化することができるのです。

関連記事

この記事のウェブストーリー版はこちらでご覧いただけます。